Paper_BC_5210100026_5210100082

-

Upload

helmi-setiawan -

Category

Documents

-

view

225 -

download

0

Transcript of Paper_BC_5210100026_5210100082

7/22/2019 Paper_BC_5210100026_5210100082

http://slidepdf.com/reader/full/paperbc52101000265210100082 1/5

7/22/2019 Paper_BC_5210100026_5210100082

http://slidepdf.com/reader/full/paperbc52101000265210100082 2/5

2

Pada metode DT, dikenal dua istilah umum yaitu BinarySplit dan Multi-way Split. Binary split digunakan untukmembagi value atribut menjadi dua pengelompokan atau lebih.Gunanya adalah untuk menghitung DT mana yang palingoptimal. Sedangkan Multi-way split digunakan untuk tiap-tiapvalue atribut yang berbeda.

C. Algoritma I D3

Iterative Dichotomiser 3 (ID3) merupakan sebuah metodeyang digunakan untuk membangkitkan pohon keputusan.

Algoritma pada metode ini berbasis pada Occam’s razor: lebih

memilih pohon keputusan yang lebih kecil (teori sederhana)dibanding yang lebih besar. Tetapi tidak dapat selalu

menghasilkan pohon keputusan yang paling kecil dan karena

itu occam’s razor bersifat heuristik. Occam’s razor

diformalisasi menggunakan konsep dari entropi informasi.

Berikut algoritma dari ID3 :

Adapun sample data yang digunakan oleh ID3 memiliki

beberapa syarat, yaitu:

1. Deskripsi atribut-nilai. Atribut yang sama harus

mendeskripsikan tiap contoh dan memiliki jumlah

nilai yang sudah ditentukan.

2. Kelas yang sudah didefinisikan sebelumnya. Suatuatribut contoh harus sudah didefinisikan, karena

mereka tidak dipelajari oleh ID3.

3. Kelas-kelas yang diskrit. Kelas harus digambarkan

dengan jelas. Kelas yang kontinu dipecah-pecah

menjadi kategori-kategori yang relatif, misalnya saja

metal dikategorikan menjadi “hard, quite hard,

flexible, soft, quite soft”.

4. Jumlah contoh (example) yang cukup. Karena

pembangkitan induktif digunakan, maka dibutuhkan

test case yang cukup untuk membedakan pola yangvalid dari peluang suatu kejadian.Pemillihan atribut pada ID3 dilakukan dengan properti

statistik, yang disebut dengan information gain. Gain

mengukur seberapa baik suatu atribut memisahkan training

example ke dalam kelas target. Atribut dengan informasi

tertinggi akan dipilih. Dengan tujuan untuk mendefinisikan

gain, pertama-tama digunakanlah ide dari teori informasi yangdisebut entropi. Entropi mengukur jumlah dari informasi yang

ada pada atribut.

Contoh perhitungan Entropy adalah:

j

t j pt j pt Entropy )|(log)|()( 2

C1 0

C2 6

C1 1

C2 5

C1 2C2 4

D. WEKA

WEKA (Waikato Environment for Knowledge Analysis)

adalah suatu perangkat lunak pembelajaran mesin yang

populer ditulis dengan Java, yang dikembangkan di

Universitas Waikato di selandia baru. WEKA adalah

perangkat lunak gratis yang tersedia di bawah GNU General

Public License. Pada WEKA menyediakan penggunaan teknik

klasifikasi menggunakan pohon keputusan dengan algoritma

J48. Teknik klasifikasi dan algoritma yang digunakan diWEKA disebut classifier.

E. J48 pada WEKA

J48 merupakan open source Java sebagai pelaksanaalgoritma C4.5 di aplikasi WEKA data mining.

C4.5 sendiri adalah algoritma yang digunakan untukmenghasilkan decission tree atau pohon keputusan yangdikembangkan oleh Ross Quinlan. C4.5 merupakan

perpanjangan dari algoritma ID3. Pohon-pohon keputusan yangdihasilkan oleh C4.5 dapat digunakan untuk melakukanklasifikasi dan untuk alasan ini, C4.5 sering disebut sebagaiclassifier statistik. (WIKIPEDIA, 2013)

III. METODOLOGI

Tahapan metodologi yang dilakukan untuk dapatmenghasilkan decision tree dari data permainan tic-tac-toeadalah dijelaskan di dalam Gambar 2 di bawah ini.

Gambar III-1 Metodologi yang dilakukan

Penjelasan dari langkah-langkah metodologi tersebutadalah sebagai berikut:

B. Analisis Decision Tree

a. Pembuatan dengan

Wekab. Hasil Decision Tree

A. Distribusi Data

a. Pengambilan Data b. Analisis Data

P(C1) = 1/6 P(C2) = 5/6

Entropy = – (1/6) log2 (1/6) – (5/6) log2

(1/6) = 0.65P(C1) = 2/6 P(C2) = 4/6Entropy = – (2/6) log2 (2/6)

– (4/6) log2

(4/6) = 0.92

P(C1) = 0/6 = 0 P(C2) = 6/6 = 1

Entropy = – 0 log 0 – 1 log 1 = – 0 – 0 = 0

7/22/2019 Paper_BC_5210100026_5210100082

http://slidepdf.com/reader/full/paperbc52101000265210100082 3/5

3

A. Distribusi Data di dalam langkah pertama inidibagi menjadi dua, yaitu proses pengambilan dataserta analisis dari data yang telah didapatkan.

a. Pengambilan data:Pada langkah ini dilakukan proses

pengambilan data yang berasal dariwebsite UCI Machine Learning

Repository.

b. Analisis data:Di dalam langkah ini dilakukan analisisdata yang telah didapatkan. Yaitumenjelaskan atribut-atribut yang dimiliki,serta keterangan-keterangan yangdidapatkan dari informasi data tersebut.

B. Analisis Decision Tree pada langkahmetodologi ini terdapat dua langkah di dalamnya,yaitu pembuatan decision tree denganmenggunakan tools Weka serta bagaimana prosesmendapatkan hasil decision tree tersebut.

a. Pembuatan dengan Weka:Pada langkah ini, dilakukan tahap-tahap

pembuatan decision tree menggunakan

tools Weka.b. Hasil Decision Tree:

Kemudian pada langkah ini didapatkanhasil berupa decision tree dan kemudianketerangan mengenai hasil yangdidapatkan.

IV. ANALISIS

Sesuai dengan alur metodologi, maka tahapan analisis yangakan dilakukan adalah terhadap berikut ini:

A. Distribusi Dataa. Pengambilan Data

Data didapatkan melalui website UCI Machine Learning Repository, dimana data tersebut berjumlah 958 yang terbagi

ke dalam 9 atribut dan 1 kelas. Data tersebut adalah sebagai

berikut.

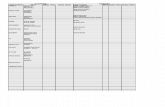

Tabel IV-1 Distribusi Data tic-tac-toe

b. Analisis Data

Tabel 4.3 merupakan tampilan tabel yang berisi data yang

telah didapatkan melalui sumber. Keterangan dari tabel di atas

adalah:

Tabel IV-2 analisis data tic-tac-toe

Nama Atribut Keterangan Atribut

Top-left-square x, o, b

Top-middle-square x, o, b

Top-right-square x, o, b

Middle-left-square x, o, b

Middle-middle-square x, o, b

Middle-right-square x, o, b

Bottom-left-square x, o, b

Bottom-middle-square x, o, b

Bottom-right-square x, o, b

Class Postive, negative

Keterangan:

x jika pemain menandai ruang dengan tanda X

o jika pemain menandai ruang dengan tanda O

b jika pemain tidak menandai ruang (kosong)

B. Anal isis Decision T reea. Pembuatan Dengan Weka

Untuk dapat menemukan pohon keputusan dari data yangdiperoleh, maka sebelumnya terdapat langkah-langkah yaitu:

Mengubah data keseluruhan menjadi format .csv Memasukkan data ke dalam Weka, dimana dari

proses tersebut akan menghasilkan visualisasi datasebagai berikut.

7/22/2019 Paper_BC_5210100026_5210100082

http://slidepdf.com/reader/full/paperbc52101000265210100082 4/5

4

Gambar IV-1 hasil visualisasi data

Warna biru menunjukkan kelas positive sedangkan warnamerah menunjukkan kelas negative. Kemudian terdapatsembilan bagian tabel yang menunjukkan masing-masing hasilvisualisasi dari setiap atribut. Atribut tersebut merupakanlangkah-langkah jawaban yang dipilih oleh masing-masing

pemain. Kemudian langkah selanjutnya adalah masuk ke

dalam tab menu classify, kemudian memilihclassifier yaitu J-48 dan menggunakan pilihan tes

percentage split untuk dapat menghitung nilaiketepatan maupun kesalahan yang ada di dalamdata tersebut. Untuk dapat melakukan

perbandingan, maka dibuatlah tabel percentage split seperti pada tabel III.3 yang dapatdigunakan untuk membandingkan tingkaterror/correct data tic-tac-toe berdasarkan

persentage split yang dimiliki.

Tabel IV-3 percentage split (%) data tic-tac-toe

PercentageSplit

(%)

CorrectlyClassifiedInstances

IncorrectlyClassifiedInstances

MeanAbsolute

Error

RootMean

SquaredError

RelativeAbsolute

Error

RootRelativeSquared

Error

TotalNumber ofInstances

10573

(66.4733 %)

289

(33.5267 %)0.3703 0.5259 83.6955 % 109.6641

% 862

20521

(68.0157 %)

245

(31.9843 %)0.3835 0.5052 84.9268 % 105.9987

% 766

30527

(78.5395 %)

144

(21.4605 %)0.2754 0.4348 60.4564 % 91.6311 % 671

40

451

(78.4348 %)

124

(21.5652 %) 0.2617 0.4251 57.4967 % 89.864 % 575

50383

(79.9582 %)

96

(20.0418 %)0.2414 0.4052 53.2533 % 85.6986 % 479

60308

(80.4178 %)

75

(19.5822 %)0.2332 0.395 51.6696 % 84.2528 % 383

70228

(79.4425 %)

59

(20.5575 %)0.2283 0.4017 50.9345 % 86.1362 % 287

80161

(83.8542 %)

31

(16.1458 %)0.1923 0.3709 43.4186 % 80.4313 % 192

90 84(87.5 %)

12(12.5 %)

0.1318 0.3156 30.0419 % 68.8202 % 96

Setelah adanya perbandingan tersebut maka dapatdiketahui tingkat persentase split dari data yangsalah maupun yang benar. Kemudian jika masukke dalam tab menu classify, kemudian memilih

classifier yaitu J-48 dan menggunakan pilihan tes percentage split 66% , maka akan didapatkan hasildecision tree sebagai berikut.

7/22/2019 Paper_BC_5210100026_5210100082

http://slidepdf.com/reader/full/paperbc52101000265210100082 5/5

5

Gambar IV-2 hasil decision tree

Di dalam hasil pohon keputusan tersebut, tampak bahwa

perbedaan dari masing-masing pemain ketika memilih tanda,dan di urutan ruang yang berbeda maka akan mengeluarkan

hasil akhir yang berbeda pula yaitu menang atau kalah.

V. SIMPULAN

Terdapat beberapa kesimpulan yang bisa diperoleh darihasil analisis diatas, antara lain:

1) Melalui hasil perbandingan percentage split didapatkaninformasi bahwa persentase correctly classified instancesdengan nilai paling besar yaitu pada persentase tingkat 90yaitu sejumlah 87.5%. Serta jika dilihat dari incorrectly

classified instances pada tingkat persentase 90% didapatkan

nilai terkecil yaitu 12.5%.

DAFTAR PUSTAKA

[1] WIKIPEDIA. (2013, October 14). C4.5 Algorithm. Retrieved fromWIKIPEDIA: http://en.wikipedia.org/wiki/C4.5_algorithm

[2] WIKIPEDIA. (2013, October 23). Tic-tac-toe. Retrieved fromWIKIPEDIA: http://en.wikipedia.org/wiki/Tic-tac-toe

[3] Aha, D. W. (1991, August 19). Retrieved fromhttp://archive.ics.uci.edu/ml/datasets/Tic-Tac-Toe+Endgame